模型构建

模型管理

功能说明

功能说明

注册/导入传统模型及大模型训练到模型管理页面进行统一管理。

操作说明

操作说明

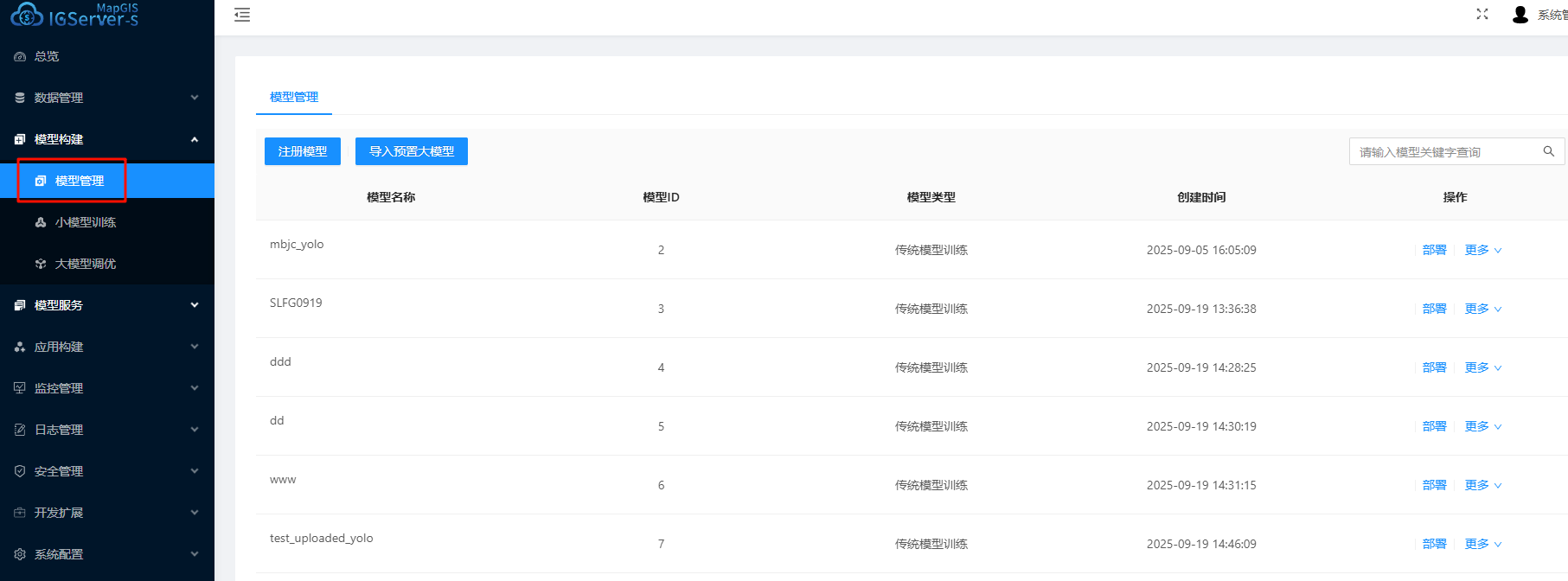

1、登录系统,切换到"模型构建"->"模型管理"页面,选择“注册模型”,进入到注册模型页面:

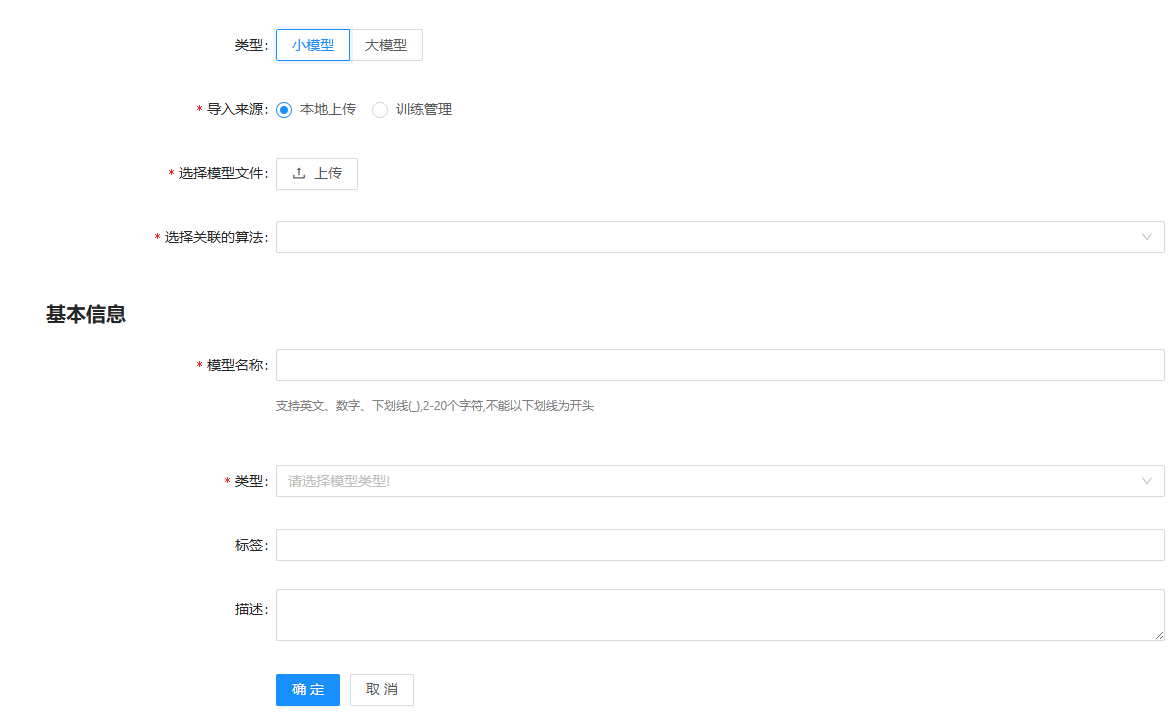

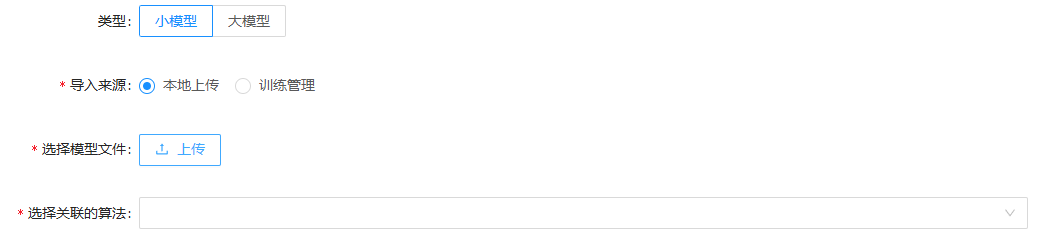

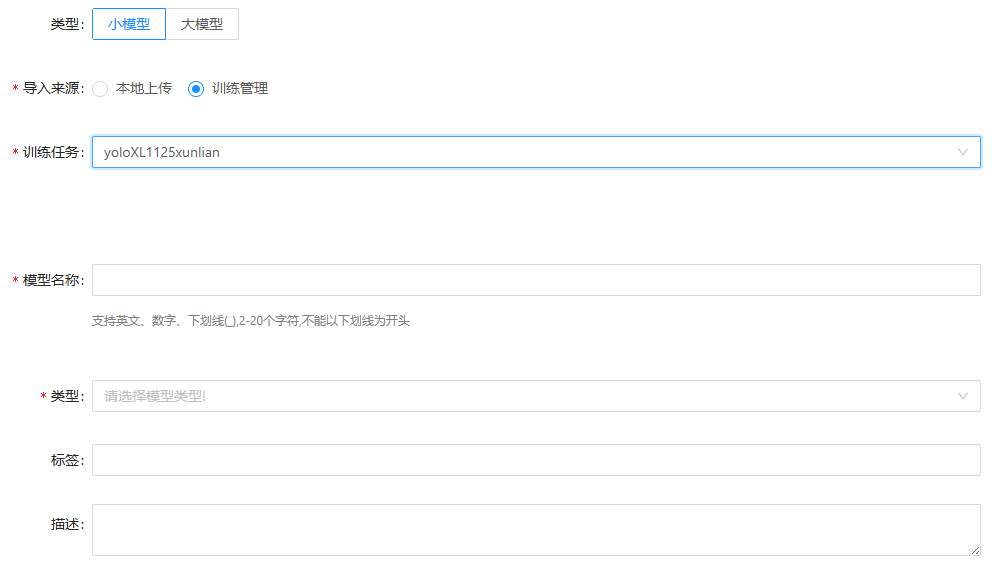

2、选择注册小模型,添加注册相关参数信息,完成后“确定”,被注册小模型将在模型管理列表中列出;

【导入来源】:支持本地上传和训练管理两种方式;

【选择模型文件/训练任务】:支持本地上传已有模型训练文件/支持已在系统中训练完成的模型任务;

【选择关联的算法】:选择系统中内置的适合模型训练任务对应算法;

【模型名称】:可自定义名称;

【类型】:小模型选择传统模型训练;

【标签/描述】:非必填,可任意填写;

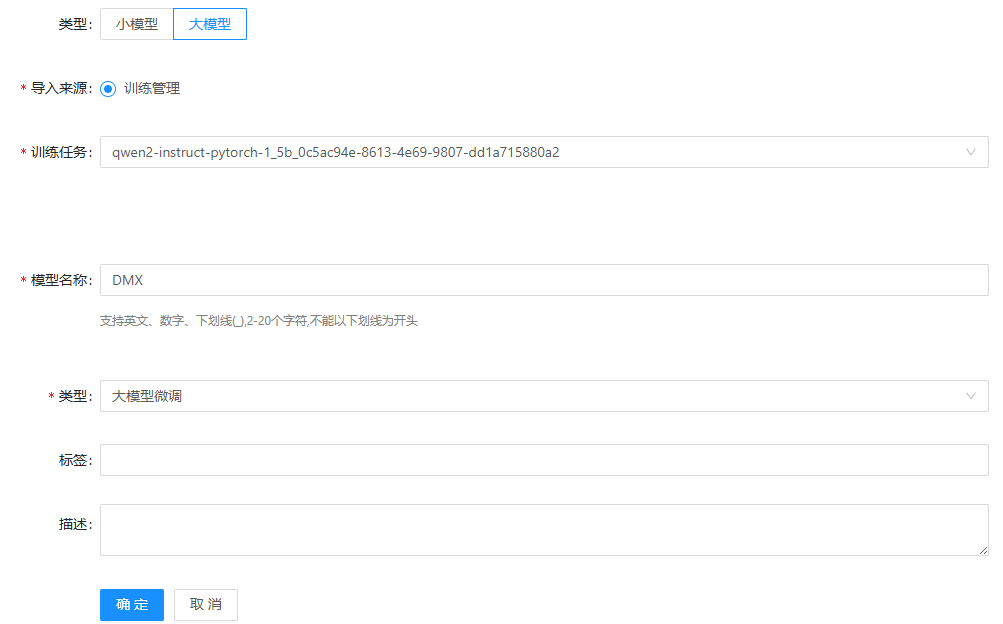

3、选择注册大模型,添加注册相关参数信息,完成后“确定”,被注册大模型将在模型管理列表中列出;

【导入来源】:只支持训练管理;

【训练任务】:支持已在系统中训练完成的大模型任务;

【模型名称】:可自定义名称;

【类型】:大模型选择大模型微调;

【标签/描述】:非必填,可任意填写;

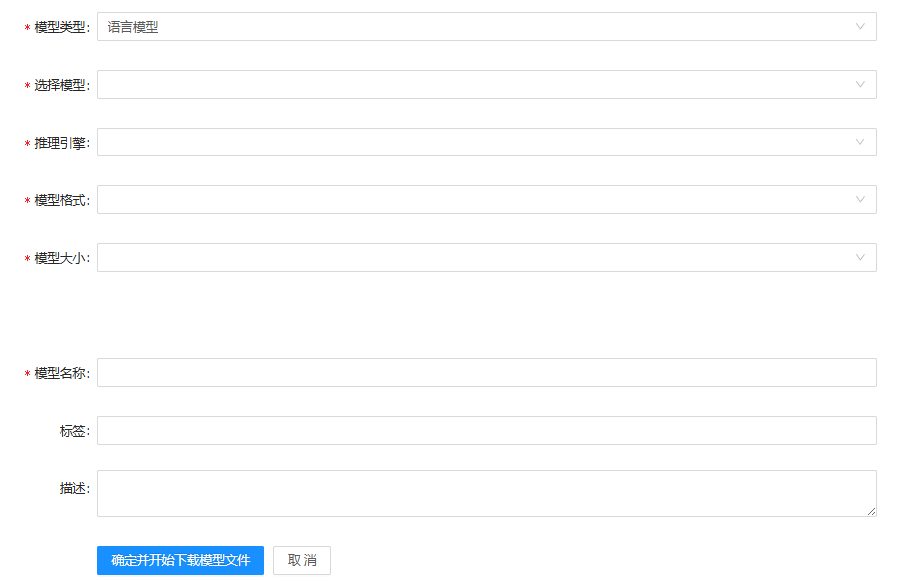

4、支持导入预制大模型,将第三方已经成型的训练模型(如qwen、deepseek等)下载并注册进来统一管理应用。"模型管理"页面,选择“导入预制大模型”,进入到注册模型页面;

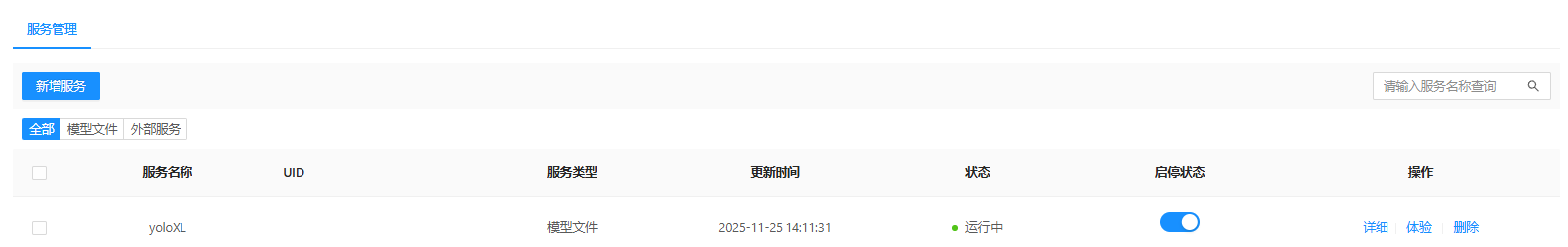

5、模型注册完成后,管理页面支持模型部署、训练及删除等基本操作,部署应用操作具体见“模型推理”章节。

小模型训练

功能说明

功能说明

不同场景各类模型训练算法的统一注册及管理。

操作说明

操作说明

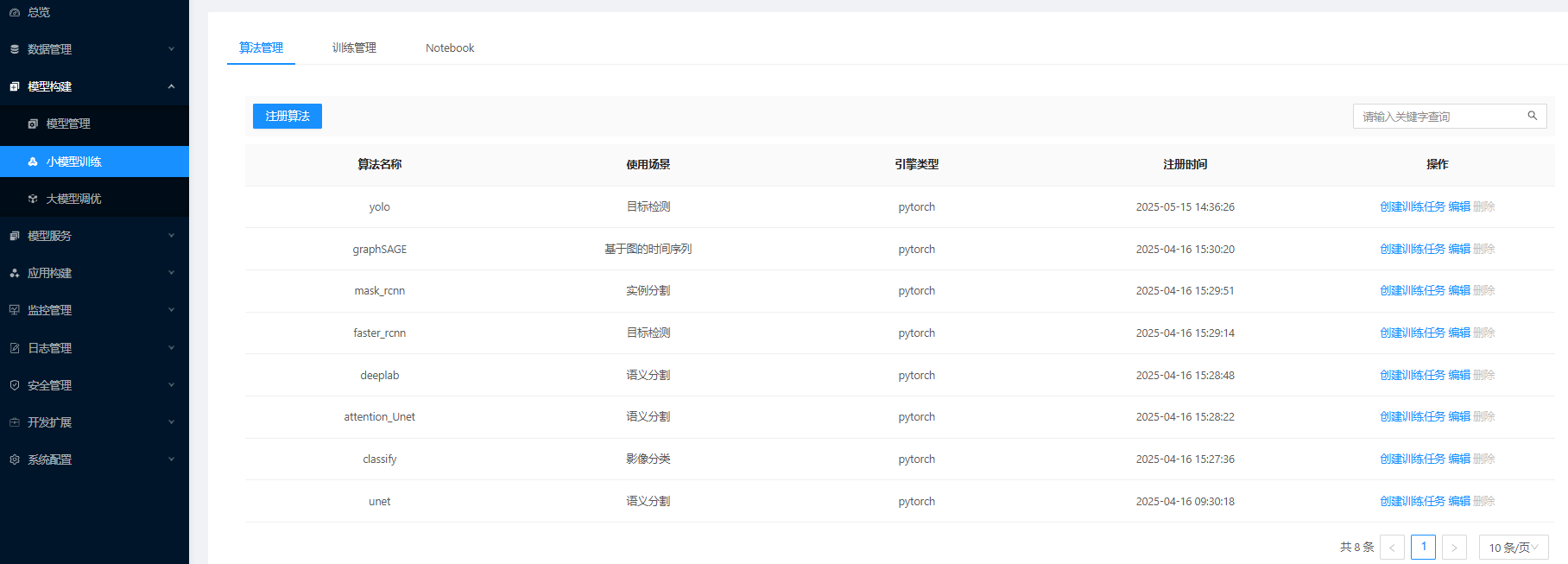

1、登录系统,切换到"模型构建"->"小模型训练"页面,选择“注册算法”,进入到注册模型算法页面,提供给开发着自定义模型算法,注册成功在管理列表统一管理。系统也内置了如mask_rcnn、faster_rcnn、unet等八种算法。

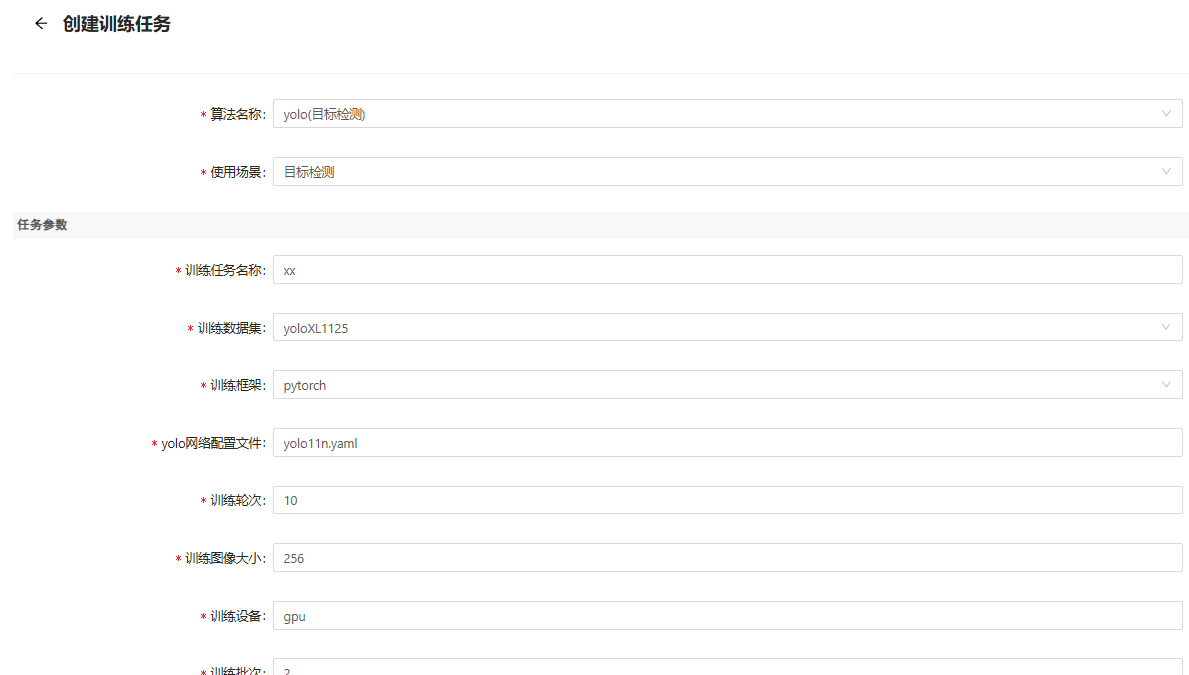

2、注册成功后,通过算法操作列表下的“创建训练任务”可创建训练任务,创建训练任务具体可参考“数据集管理”模块,同时管理列表还支持编辑/删除/检索等常规操作。

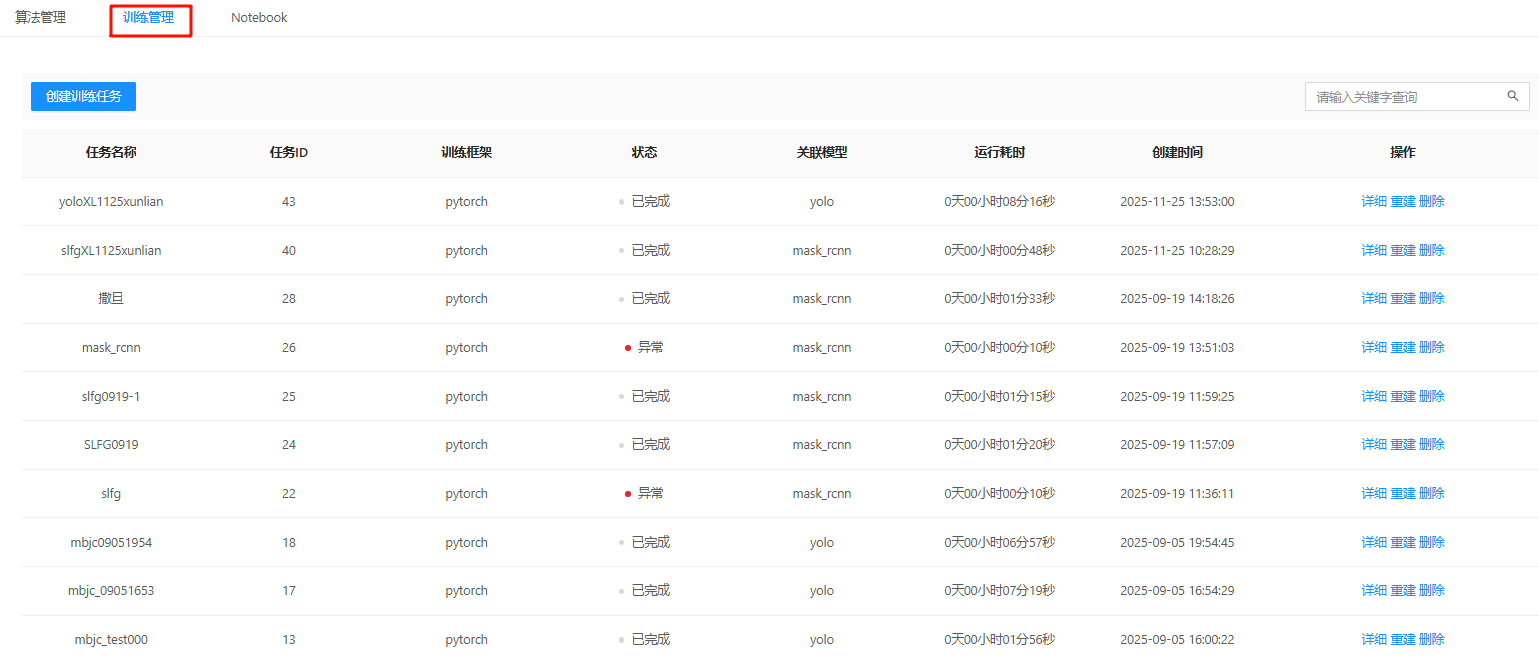

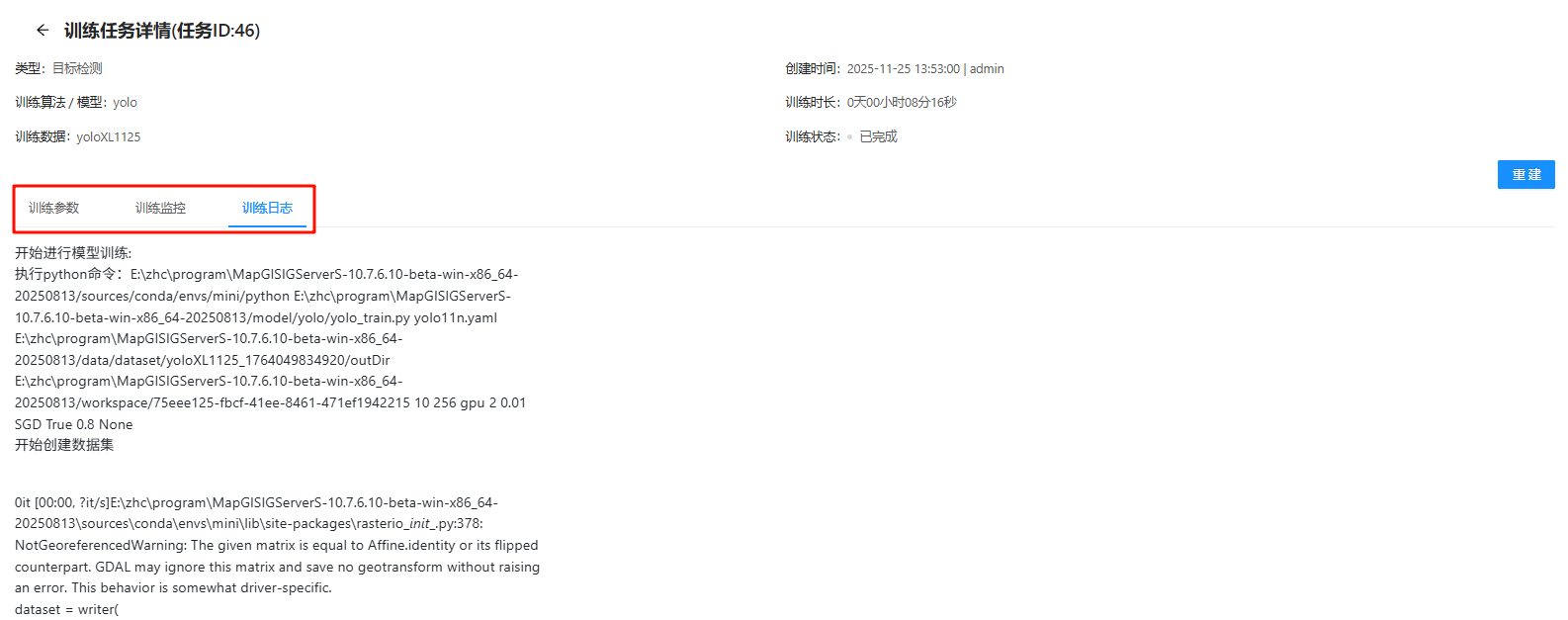

3、“训练管理”,创建成功的训练任务,可查看任务的详细进度。包括训练参数、训练监控、训练日志等信息,也支持训练任务重跑及删除操作。

4.、支持Notebook交互式开发环境,用户可创建和共享实时代码。

大模型调优

参数说明

参数说明

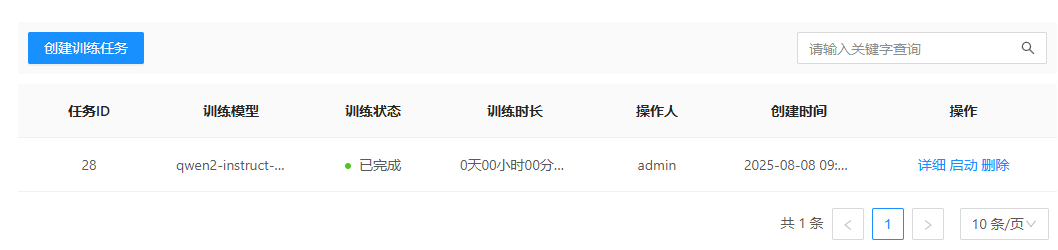

1. 登录系统,切换到"模型构建"->"大模型调优"页面,列表中可显示所有大模型调优任务:

2. 点击"创建训练任务",可新建模型微调任务:

- 【选择模型类型】:可支持"qwen2-instruct:1_5B"和"deepseek-r1-distill-qwen:14B"两种模型类型;

- 【选择微调lora模型】:LoRA(Low-Rank Adaptation)是一种参数高效的微调方法,它通过在预训练模型的权重矩阵上引入低秩矩阵来实现对模型的微调。相比全参数微调,LoRA 只需训练少量新增参数(通常 <1%),即可达到接近全量微调的效果,同时节省显存和计算资源

- 【模型id或者路径】:系统可自动读取模型路径;

- 【选择训练数据】:

- 【结果保存路径】:系统可自动设置结果保存路径;

- 【验证集拆分比例】:在进行大模型调优时,通常会将训练数据集按一定比例拆分为训练集和验证集,此处可设置验证集比例;

- 【句子最大长度】:输入模型前,对文本序列进行截断或填充的最大长度。

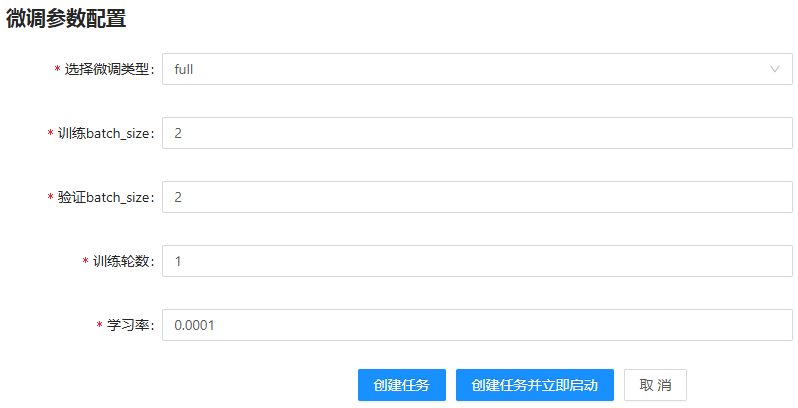

3. 微调参数配置。

- 【选择微调类型】:目前可支持full(Full Fine-tuning全参数微调) 和 LoRA(Low-Rank Adaptation)微调 是两种主流方法;

- 【训练batch_size】:训练批次大小,指的是在更新模型权重之前处理的数据样本数量。对于大型模型,通常设置为 1 到 8。如果使用混合精度训练或模型量化技术,可以适当增大 batch size

- 【验证batch_size】:应用于验证集上,用于评估模型性能而不是更新权重。较小的 batch_size 可以加快单次评估的速度,但对于大规模验证集来说,可能需要更多的时间来完成整个验证过程。

- 【训练轮数】:一个 epoch 表示遍历一次完整的训练数据集。

- 【学习率】:控制权重更新步长的一个超参数。

4. 点击"创建任务"即可创建大模型调优任务;点击"创建任务并立即启动"即可创建大模型调优任务并启动任务。

5. 在"模型微调"列表,点击训练任务后方的"详情",可查看训练任务的详细信息。

6. 在"模型微调"列表,点击训练任务后方的"启动",可执行训练任务。

7. 在"模型微调"列表,点击训练任务后方的"删除",可删除训练任务。